Cuando Apple presentó su propio modelo de inteligencia artificial, Apple Intelligence, se desmarcó de la competencia priorizando la privacidad del usuario. Es decir, Tim Cook recalcó que su IA sería potente, intuitiva, integrada y personal. Pero, lo más importante, sería privada. A diferencia de modelos como Claude, Gemini, Meta AI o GPT, que se comunican con servidores externos a través de internet para satisfacer nuestras preguntas y peticiones. Y una de las razones de esa privacidad era que la IA funcionaba en modo local. Con el tiempo, han surgido alternativas similares que te permiten probar distintos modelos de IA en local. Un ejemplo: la app Locally AI.

Cuando Tim Cook presentó Apple Intelligence al mundo, dijo que su IA realizaba parte del trabajo en modo local. Gracias, en gran parte, a los potentes chips de Apple que ya integran prácticamente todos los iPhone, iPad y Mac del mercado. Unos años después, la idea sigue en pie, pero el modelo de IA de Apple no termina de despegar. Hace poco hemos sabido que en el futuro, Apple Intelligence será compatible con Gemini, Claude y otras IA. Algo parecido a lo que ya viene ocurriendo con OpenAI. Con las ventajas que supone en cuanto a privacidad frente a usar directamente esos modelos de IA desde las apps oficiales.

En paralelo, otros proyectos se dedican a ofrecer algo parecido, pero a su manera. La posibilidad de beneficiarte de la inteligencia artificial en tus dispositivos móviles, portátiles o de sobremesa, pero empleando modelos abiertos que puedes instalar. IA en modo local que te da más control y tranquilidad sobre la inteligencia artificial y sobre los datos e información que compartes con esta tecnología. Si en PC y Mac tenemos Ollama, LM Studio o NodeTool, y en Android existen soluciones como SmolChat o Google AI Edge Gallery, si tienes iPhone, iPad y/o Mac, te proponemos que pruebes Locally AI. Una app que te permitirá probar los modelos de IA abiertos más potentes en modo local.

Para qué sirve Locally AI

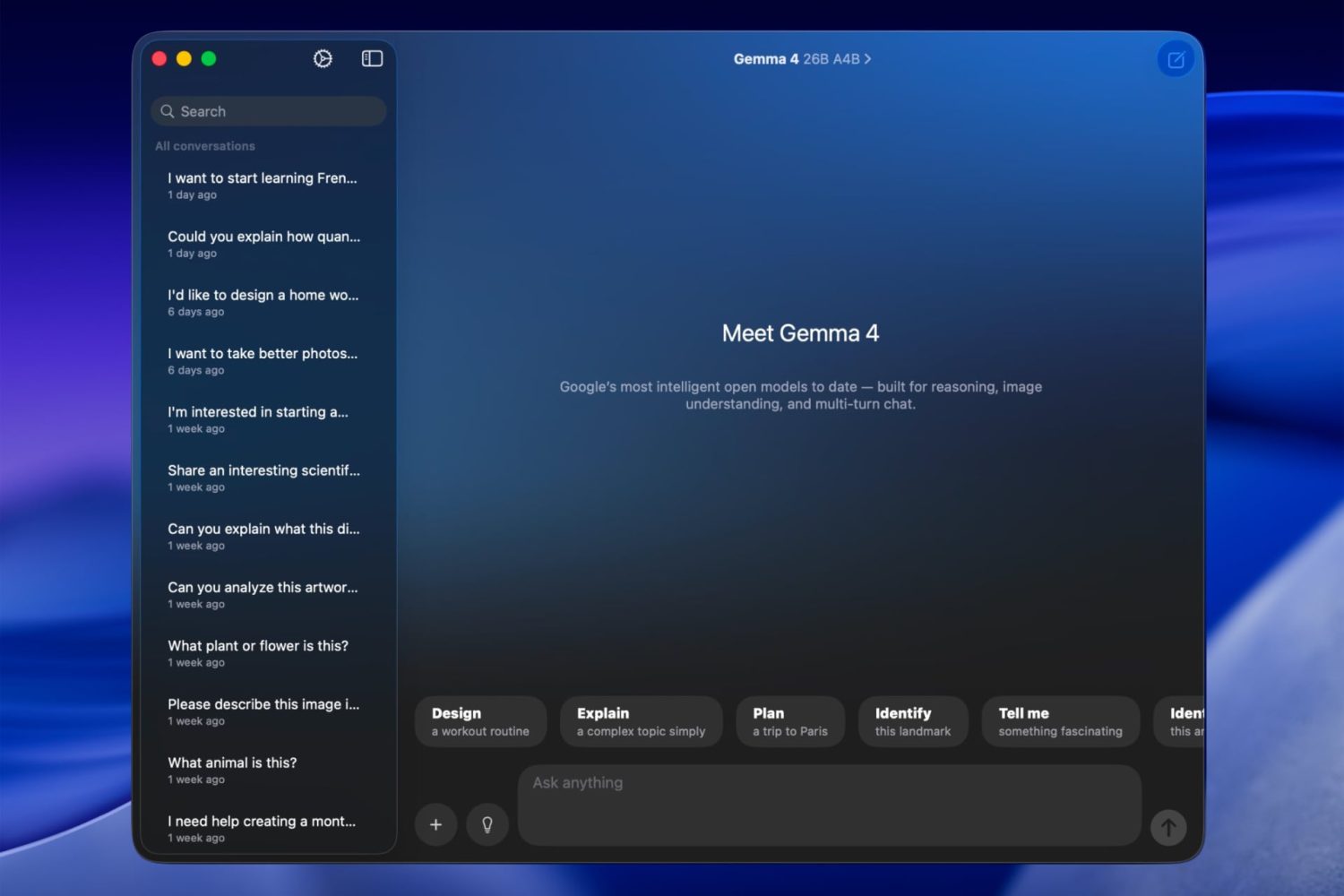

Su nombre lo dice todo. Locally AI es una app gratuita, sin publicidad y de código abierto, que puedes instalar en iPhone, iPad y Mac. Y, como su nombre indica y nos explica su página oficial, sirve para instalar y ejecutar modelos de IA sin conexión, de forma privada y sin necesidad de registrarte ni iniciar sesión. Y, entre otras ventajas, esta app está optimizada para procesadores Apple Silicon. De ahí que, de momento, no tenga versión para Windows, Linux ni Android.

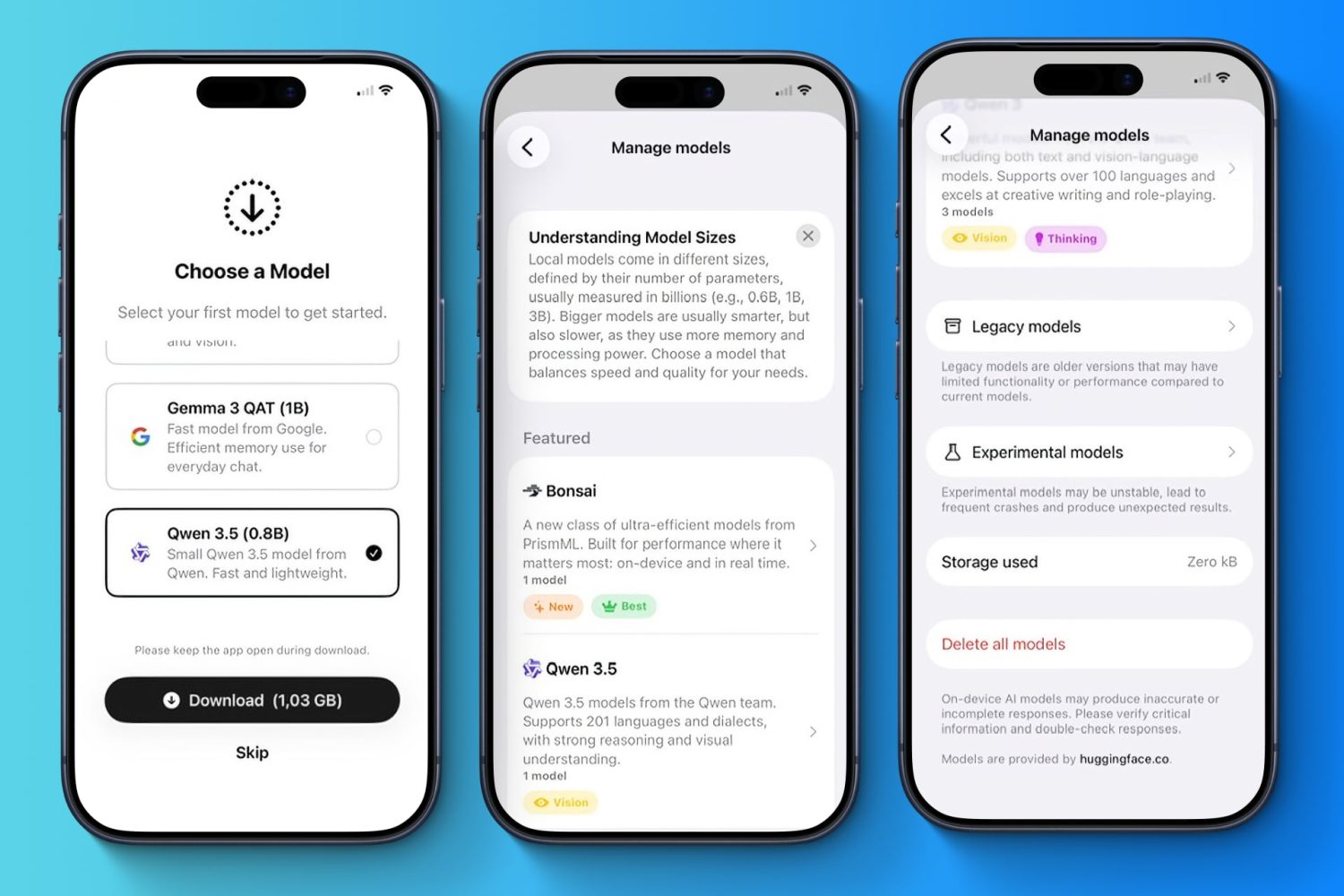

En el momento de escribir estas líneas, Locally AI es compatible con los siguientes modelos de IA en distintas versiones. Según indica su web, “todos los modelos se ejecutan completamente sin conexión en tu dispositivo con la optimización de Apple Silicon para un máximo rendimiento y privacidad”:

- Llama. Es el modelo de IA de Meta. El que hace funcionar Meta AI, por ejemplo.

- Gemma. Es el modelo de IA abierto de Google. Emparentado con Gemini.

- SmolLM. La IA de Hugging Face, una plataforma de referencia en IA.

- DeepSeek. La IA china que hizo desplomarse NVIDIA en bolsa. Y que siempre da que hablar.

- Qwen. Es el modelo de IA de Alibaba, un gigante tecnológico chino.

- Granite. Este modelo de IA viene de IBM, el gigante azul. Enfocado al mundo empresarial.

- Cogito. Un modelo de IA de la startup estadounidense Deep Cogito. Prometedor.

- LFM. Acrónimo de Liquid Foundation Models, una familia de modelos de IA de la startup Liquid AI. Optimizados para móviles y wearables.

Qué puedes hacer con Locally AI

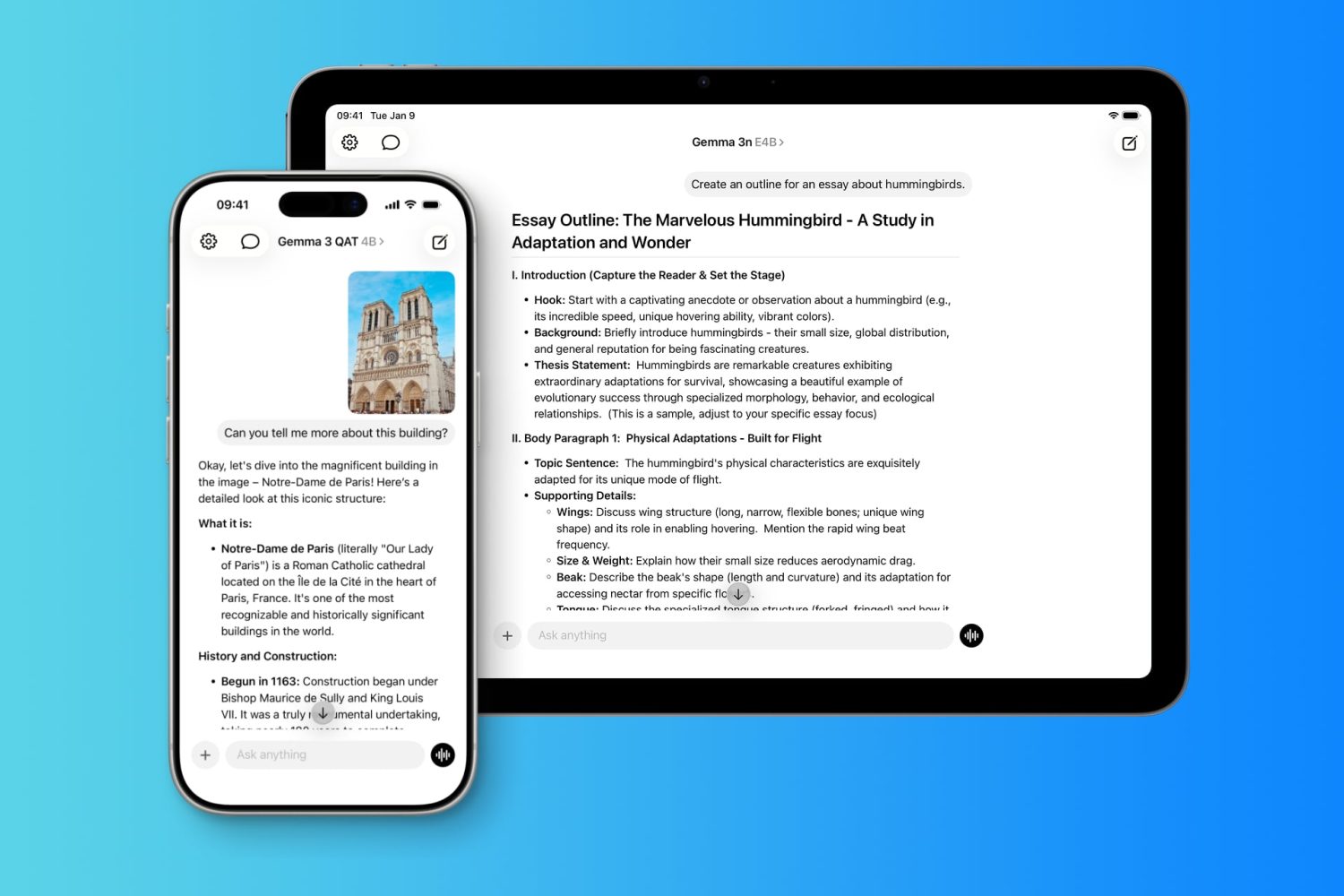

El propósito de Locally AI es facilitarte la tarea de instalar modelos de IA abiertos en tu iPhone, iPad y Mac. Pero, ¿qué puedes hacer con eso? Como ocurre con ChatGPT, Claude o Gemini, la app Locally AI hace de intermediaria entre el usuario y la inteligencia artificial. Y si ya utilizas algunos de los asistentes antes mencionados, su funcionamiento es idéntico. Instalas el modelo de IA, inicias una conversación o chat y a pedirle cosas. Además, podrás compartir con la IA documentos y archivos para que los procese. Eso sí, sin conectarse a internet salvo para buscar información.

Como ocurre con otros asistentes de IA, Locally AI te permite usar el modo voz de los modelos de IA compatibles. Es decir, que podrás hablar con la IA en vez de escribirle mensajes. Y como funciona en local, tu voz se queda ahí. No se procesa en la nube. Además, la aplicación se integra en el dispositivo de Apple como otras apps, de manera que puedes abrir Locally AI con Siri, crear automatismos con la app Atajos o añadir botones a la pantalla de bloqueo, el centro de control o usar el botón de acción para abrir Locally AI.

Ventajas e inconvenientes de la IA local

Aunque ya hemos mencionado, en gran medida, las principales ventajas de usar IA en modo local en vez de hacerlo con los modelos online más populares, hagamos un breve repaso. Y, ya que estamos, veamos las principales desventajas o inconvenientes de la IA en modo local.

- Offline. Al tener la IA en modo local, no necesita conectarse a internet para enviar tus preguntas, compartir tus datos con sus servidores y devolverte la respuesta. Todo se hace en tu iPhone, iPad o Mac.

- Privado y seguro. Al funcionar en modo local, tus datos y archivos compartidos no salen de tu dispositivo. No hay procesamiento en la nube, ni se recopilan datos. En la App Store se nos avisa de que esta app, de momento, “no se recopilan datos”.

- Más control sobre la IA. Otra consecuencia de instalar la IA en tu dispositivo es que tienes más control sobre ella y puedes personalizarla más fácilmente. Siempre y cuando sepas escribir los prompts adecuados.

¿Y qué hay de los inconvenientes? No todo es positivo. E, inevitablemente, siempre hay un precio a pagar. Aunque no literal.

- Ocupa espacio. Los modelos de IA ocupan mucho en un disco o unidad de almacenamiento. A más potente y complejo, más espacio. De manera que si vas a usar IA en modo local en tu iPhone, tenlo presente porque tal vez debas renunciar a ciertas apps y juegos. En iPad y Mac, te será más llevadero, pero también tiene espacio limitado.

- La potencia de tu chip. Otra consecuencia de usar la IA en local es que utiliza el chip de tu iPhone, iPad o Mac para realizar su trabajo. Esto implica un uso intensivo del chip. Por lo que el dispositivo se puede calentar y la batería durar menos. Y si el chip no es suficientemente potente, puede que las respuestas a tus peticiones tarden algo más de lo deseado. No es lo mismo un A18 que un M5. Y lo mismo ocurre con un A18 y un A18 Pro o un M5, M5 Pro o M5 Max.

Locally AI y LM Studio

Si no te termina de convencer Apple Intelligence o desconfías de Claude, Gemini o ChatGPT, aplicaciones como Locally AI te abren las puertas a trabajar con modelos de IA abiertos y en modo local que pueden darte mejores resultados en determinadas tareas. A lo que hay que añadir la ventaja de la privacidad y que la app esté diseñada para trabajar mano a mano con tus dispositivos Apple.

Y si todavía no conocías Locally AI, otra razón para probarla es que ha llamado la atención de LM Studio, una de las herramientas más conocidas para interactuar con modelos de IA abiertos. A principios de abril, LM Studio anunciaba que había comprado Locally AI. Y que su creador, Adrien Grondin, entra a formar parte del equipo que desarrolla LM. Por ahora, esto no impide que Locally AI siga actualizándose con regularidad para ser compatible con las versiones más recientes de sus modelos de IA compatibles. Por lo demás, ambas herramientas son gratuitas. Sin embargo, LM Studio está centrada en Windows y macOS, mientras que Locally AI se puede usar en iOS, iPad y macOS.

DERECHOS DE AUTOR

Esta información pertenece a su autor original y fue recopilada del sitio https://hipertextual.com/guias/instalar-ia-modo-local-locally-ai-iphone-ipad-mac/